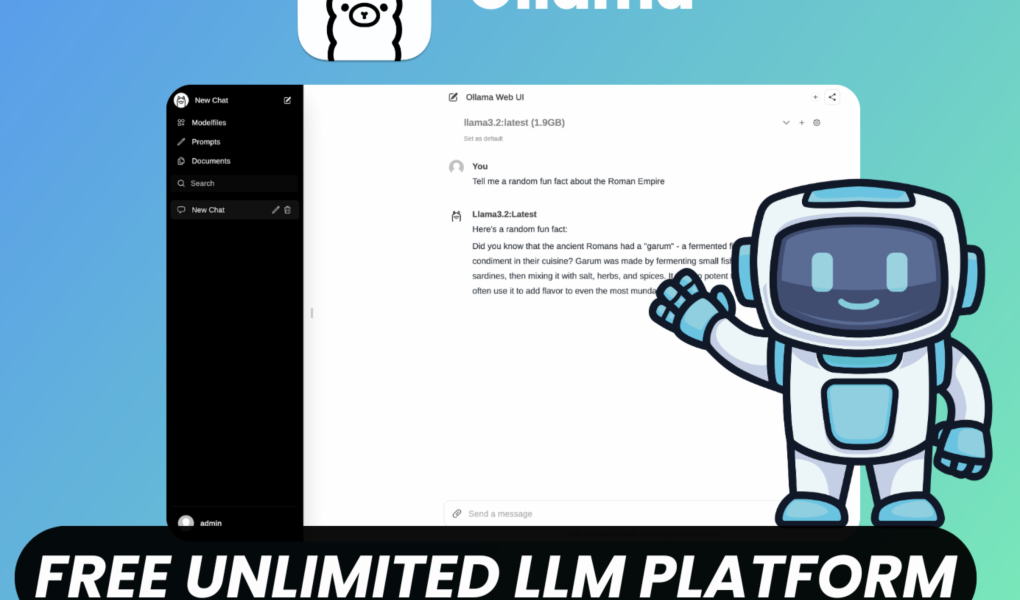

📌 Apa Itu Ollama?

Ollama adalah sebuah tools open-source yang memungkinkan kamu menjalankan Large Language Model (LLM) seperti AI ChatGPT langsung di komputer sendiri (lokal), tanpa perlu koneksi ke server cloud.

Dengan Ollama, kamu bisa menjalankan berbagai model AI seperti:

- LLaMA

- Mistral

- Gemma

- dan model lainnya

Semuanya berjalan offline di device kamu 🔥

🎯 Kelebihan Ollama

Berikut beberapa alasan kenapa Ollama semakin populer:

✅ 1. Jalan di Lokal (No Cloud)

Tidak perlu internet setelah model di-download

👉 Data kamu lebih aman & private

✅ 2. Mudah Digunakan

Cukup pakai command sederhana di terminal

✅ 3. Banyak Model AI

Bisa pilih model sesuai kebutuhan:

- Chat AI

- Coding assistant

- Data analysis

✅ 4. Gratis & Open Source

Cocok untuk developer maupun pemula

🖥️ Arsitektur Cara Kerja Ollama

Secara sederhana, Ollama bekerja seperti ini:

User → Ollama CLI → Model AI → Response

- User input prompt

- Ollama meneruskan ke model AI

- Model memproses

- Output dikembalikan ke user

⚙️ Cara Install Ollama

💻 MacOS & Linux

Jalankan perintah berikut:

curl -fsSL https://ollama.com/install.sh | sh

🪟 Windows

- Download installer dari website resmi Ollama

- Install seperti biasa

🚀 Cara Menggunakan Ollama

Setelah install, kamu bisa langsung menjalankan model AI.

1. Jalankan Model

Contoh:

ollama run llama3

Pertama kali akan otomatis download model.

2. Chat dengan AI

Setelah jalan, kamu bisa langsung tanya:

Hello, explain cloud computing

3. List Model yang Tersedia

ollama list

4. Download Model Manual

ollama pull mistral

🤖 Model AI yang Bisa Digunakan

Beberapa model populer di Ollama:

- LLaMA 3 → powerful & general purpose

- Mistral → ringan & cepat

- Gemma → dari Google

- Code Llama → khusus coding

🔗 Integrasi Ollama dengan Aplikasi Lain

Ollama bisa diintegrasikan dengan berbagai tools:

🌐 API Endpoint

Ollama menyediakan API lokal:

http://localhost:11434

Contoh request:

curl http://localhost:11434/api/generate -d '{

"model": "llama3",

"prompt": "Explain networking"

}'

🔥 Integrasi dengan Tools AI

Ollama bisa digabung dengan:

- Web UI (Open WebUI / OpenClaw)

- VSCode

- Chatbot lokal

- Automation tools

🧠 Kelebihan vs Kekurangan

👍 Kelebihan

- Privacy tinggi

- Tidak tergantung internet

- Gratis

- Bisa custom model

👎 Kekurangan

- Butuh spesifikasi PC tinggi

- Model besar (GB-an)

- Tidak sekuat cloud AI (untuk model kecil)

💻 Spesifikasi Minimum

Rekomendasi:

- RAM: minimal 8GB (16GB lebih baik)

- Storage: 10GB+

- CPU: modern (atau GPU jika ada)

🔐 Apakah Ollama Aman?

Ya, karena:

- Semua proses berjalan di lokal

- Data tidak dikirim ke server eksternal

Cocok untuk:

- Data sensitif

- Development internal

- Eksperimen AI

🎯 Use Case Ollama

Beberapa penggunaan nyata:

- Chatbot offline

- AI untuk coding

- Analisis data lokal

- Automasi script

- AI untuk edukasi

🚀 Kesimpulan

Ollama adalah solusi powerful untuk menjalankan AI secara lokal dengan mudah, cepat, dan aman.

Dengan Ollama, kamu bisa:

- Menggunakan AI tanpa internet

- Menjaga privasi data

- Membangun aplikasi AI sendiri

👉 Cocok untuk developer, IT engineer, hingga content creator.